点击下方卡片,关注“CVer”公众号

AI/CV重磅干货,第一时间送达

添加微信:CVer2233,助手会拉你进群!

扫描下方二维码,加入CVer学术星球!可获得最新顶会/顶刊上的论文idea和CV从入门到精通资料,及最前沿应用!发论文/搞科研/涨薪必备!

转载自:SCS计算机视觉专委会

多元视觉基础模型融合驱动的双目立体匹配研究

周婧伊1,张浩宇1,袁家康1,叶鹏1,3,4,陈涛1,江浩2,陈妹雅2,张阳阳2

1复旦大学,2小米,3上海人工智能实验室,4香港中文大学

AAAI 2025

撰稿人:周婧伊

通讯作者:陈涛,叶鹏

原文标题:All-in-One: Transferring Vision Foundation Models into Stereo Matching

代码链接:http://arxiv.org/abs/2412.09912

背景

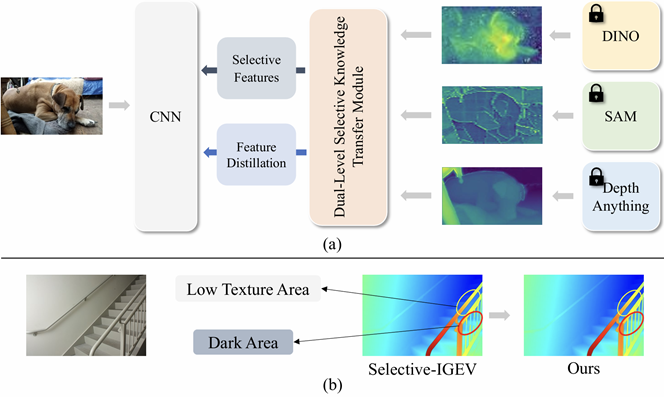

双目匹配模型旨在预测一对校正图像之间的逐像素位移(即视差),并通过相机校准进一步解码深度信息,在机器人、自动驾驶等领域有着广泛的应用。近年来,基于迭代优化的方法通过逐步更新视差图在双目匹配任务中显示出巨大的潜力。然而,现有双目模型的通用特征提取能力仍然相对较弱,原因如下:(1)最近的SOTA工作主要关注迭代更新机制的改进,而部分忽略了编码特征的质量。同时,面向任务的优化目标也使编码器难以学习全局和上下文信息。(2)双目匹配数据量相对较少,多为合成数据。模型很难从不足的数据中学习一般的表示。例如,如图1 (b)所示,以前的方法难以预测纹理特征模糊的暗区域的深度信息,因为这些区域的特征高度相似。因此,基于像素间特征匹配的视差预测容易出现较大的偏差。

近年来,视觉基础模型(visual foundation models, VFMs)涌现,并在各种任务上展现出良好的性能。这些模型在大规模数据集上训练,能够提取更加通用的特征表示,这促使我们考虑将多个VFM模型的通用特征提取能力迁移到双目匹配模型中。

图1 (a) AIO-Stereo方法概览;(b)可视化对比

方法

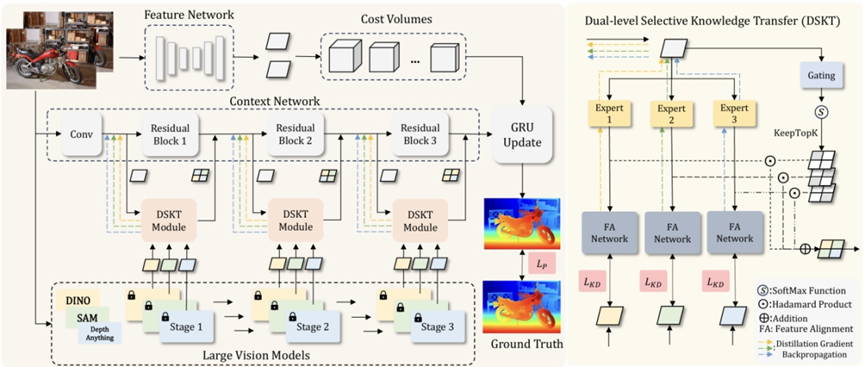

基于观察和分析,我们认为编码特征的质量对于双目匹配任务同样至关重要,因为它们构成了迭代更新模块的主要信息来源,直接影响迭代过程的每一步。为此,我们提出了一个高效的知识转移框架AIO-Stereo,该框架从多个VFM中筛选并学习有用的知识,以获得足够有效和信息丰富的特征。为了充分利用VFM的优势,首先设计了双层知识利用机制,能够有效地在异构模型之间迁移知识。然后提出了一个选择性知识迁移模块,将多个VFM的知识整合到单一的双目匹配模型中。

(1)双层知识利用机制:即在蒸馏和融合两个层次上利用知识。由于普遍基于VIT的VFM和普遍基于CNN的双目模型存在异构性,导致直接的特征蒸馏或特征融合效果欠佳,因为不同的隐空间中的特征存在不对齐。为了弥补二者的差距,我们提出并集成了一个专家网络和一个特征对齐网络来对齐异构模型之间的特征,并将VFM的通用知识转移到立体匹配模型中。

(2)选择性知识迁移模块:为了促进多个不同VFM之间的知识有效转移,同时防止不同模型之间的知识冲突,设计了选择性知识转移模块,采用带有可训练门控网络的选择性知识转移机制来为每个像素的特征选择专家,从而间接地选择来自不同的VFM的知识。

图2 AIO-Stereo的总体框架

实验结果

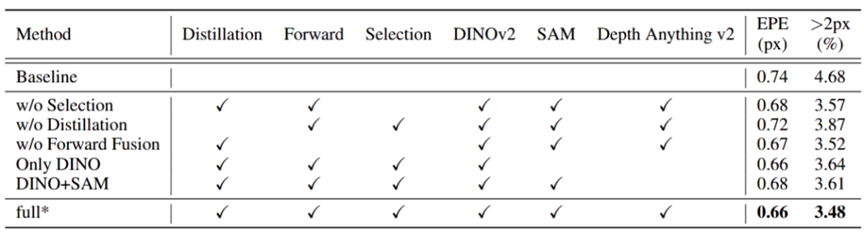

AIO-Stereo利用三个vfm(DINOv2, SAM和Depth Anything v2)的知识来增强特征表示并提高整体精度。为了验证我们的方法可以有效地整合多个vfm的优势,我们进行了使用不同数量的vfm的实验。如表1所示。当使用vfm时,性能有所提高,随着使用的vfm数量的增加,性能也在不断提高。这是因为每个VFM都有其独特的优势,来自不同VFM的知识可以被我们的AIO-Stereo有效地整合。结果突出了我们的AIO-Stereo固有的灵活性,它不依赖于单一的基础模型,而是旨在有效地协调多个模型,利用它们的优势来服务于我们的立体匹配任务。

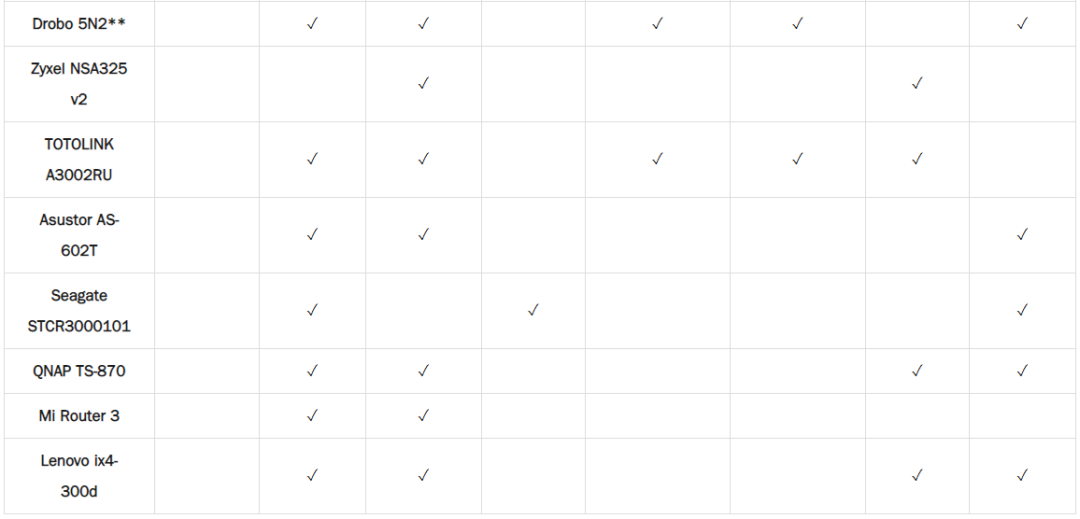

表1 消融实验:对方法的各个模块及使用的VFM进行消融

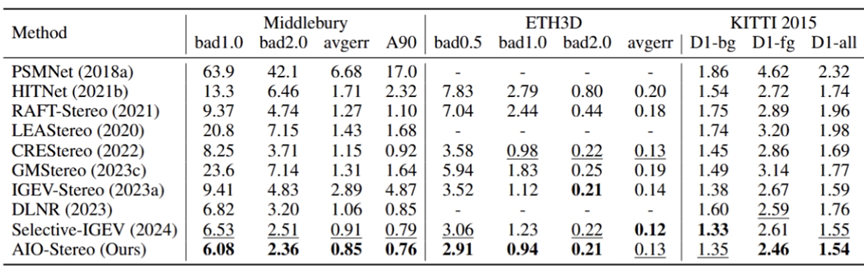

为了评估我们方法的有效性,我们将AIO-Stereo与当前的SOTA方法在Middlebury、ETH3D和KITTI 2015数据集上进行了比较,如表2所示。AIO-Stereo在Middlebury排行榜上排名第一,并在多个数据集上实现SOTA。

表2 在Middlebury,ETH3D和KITTI 2015数据集上和其他方法的对比

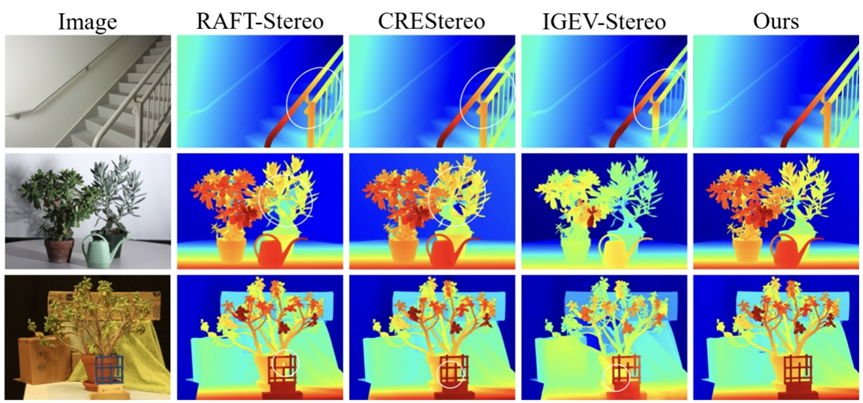

此外,我们将可视化结果与其他工作(RAFT-Stereo, CREStereo和IGEV-Stereo)进行了比较。从图可以看出,AIO-Stereo可以获得更好的可视化质量,特别是在纹理和暗区。这是因为我们的方法可以利用多个vfm并从中学习通用表示。

图3 可视化对比结果

结论

作为一项基本的视觉任务,立体匹配已经取得了显著的进展。尽管近期许多基于迭代优化的方法取得了令人期待的成果,但其特征提取能力仍存在不小的提升空间。受到视觉基础模型(visual foundation models, VFM)提取通用表示能力的启发,本文提出了AIO-Stereo方法,AIO-Stereo首次探索了利用多个VFM的知识来协同提升双目匹配性能,将多个VFM的知识迁移到单一的双目匹配模型中。实验结果表明,AIO-Stereo在多个数据集上取得了SOTA的性能,在Middlebury榜单上排名第一,并且在ETH3D榜单中超越了所有已发布的研究成果,为VFM在下游任务的知识利用提出了有潜力的解决方案。

参考文献

1. Bai, H.; Wu, J.; King, I.; and Lyu, M. 2020. Few shot network compression via cross distillation. In Proceedings of the AAAI Conference on Artificial Intelligence, volume 34, 3203–3210.

2. Bao, W.; Wang, W.; Xu, Y.; Guo, Y.; Hong, S.; and Zhang, X. 2020. Instereo2k: a large real dataset for stereo matching in indoor scenes. Science China Information Sciences, 63: 1–11.

3. Boykov, Y.; Veksler, O.; and Zabih, R. 2001. Fast approximate energy minimization via graph cuts. IEEE Transactions on pattern analysis and machine intelligence, 23(11): 1222–1239.

4. Caron, M.; Touvron, H.; Misra, I.; J´egou, H.; Mairal, J.; Bojanowski, P.; and Joulin, A. 2021. Emerging Properties in Self-Supervised Vision Transformers. In Proceedings of the International Conference on Computer Vision (ICCV).

5. Chang, J.-R.; and Chen, Y.-S. 2018a. Pyramid stereo matching network. In CVPR, 5410–5418.

6. Xu, H.; Zhang, J.; Cai, J.; Rezatofighi, H.; Yu, F.; Tao, D.; and Geiger, A. 2023. Unifying flow, stereo and depth estimation. IEEE Transactions on Pattern Analysis and Machine Intelligence.

7. Xu, H.; and Zhang, J. 2020. Aanet: Adaptive aggregation network for efficient stereo matching. In CVPR, 1959–1968.

何恺明在MIT授课的课件PPT下载

在CVer公众号后台回复:何恺明,即可下载本课程的所有566页课件PPT!赶紧学起来!

ECCV 2024 论文和代码下载

在CVer公众号后台回复:ECCV2024,即可下载ECCV 2024论文和代码开源的论文合集在CVer公众号后台回复:ECCV2024,即可下载ECCV 2024论文和代码开源的论文合集在CVer公众号后台回复:ECCV2024,即可下载ECCV 2024论文和代码开源的论文合集

CVPR 2024 论文和代码下载

在CVer公众号后台回复:CVPR2024,即可下载CVPR 2024论文和代码开源的论文合集在CVer公众号后台回复:CVPR2024,即可下载CVPR 2024论文和代码开源的论文合集在CVer公众号后台回复:CVPR2024,即可下载CVPR 2024论文和代码开源的论文合集

Mamba、多模态和扩散模型交流群成立

扫描下方二维码,或者添加微信号:CVer2233,即可添加CVer小助手微信,便可申请加入CVer-Mamba、多模态学习或者扩散模型微信交流群。另外其他垂直方向已涵盖:目标检测、图像分割、目标跟踪、人脸检测&识别、OCR、姿态估计、超分辨率、SLAM、医疗影像、Re-ID、GAN、NAS、深度估计、自动驾驶、强化学习、车道线检测、模型剪枝&压缩、去噪、去雾、去雨、风格迁移、遥感图像、行为识别、视频理解、图像融合、图像检索、论文投稿&交流、PyTorch、TensorFlow和Transformer、NeRF、3DGS、Mamba等。 一定要备注:研究方向+地点+学校/公司+昵称(如Mamba、多模态学习或者扩散模型+上海+上交+卡卡),根据格式备注,可更快被通过且邀请进群扫描下方二维码,或者添加微信号:CVer2233,即可添加CVer小助手微信,便可申请加入CVer-Mamba、多模态学习或者扩散模型微信交流群。另外其他垂直方向已涵盖:目标检测、图像分割、目标跟踪、人脸检测&识别、OCR、姿态估计、超分辨率、SLAM、医疗影像、Re-ID、GAN、NAS、深度估计、自动驾驶、强化学习、车道线检测、模型剪枝&压缩、去噪、去雾、去雨、风格迁移、遥感图像、行为识别、视频理解、图像融合、图像检索、论文投稿&交流、PyTorch、TensorFlow和Transformer、NeRF、3DGS、Mamba等。 一定要备注:研究方向+地点+学校/公司+昵称(如Mamba、多模态学习或者扩散模型+上海+上交+卡卡),根据格式备注,可更快被通过且邀请进群扫描下方二维码,或者添加微信号:CVer2233,即可添加CVer小助手微信,便可申请加入CVer-Mamba、多模态学习或者扩散模型微信交流群。另外其他垂直方向已涵盖:目标检测、图像分割、目标跟踪、人脸检测&识别、OCR、姿态估计、超分辨率、SLAM、医疗影像、Re-ID、GAN、NAS、深度估计、自动驾驶、强化学习、车道线检测、模型剪枝&压缩、去噪、去雾、去雨、风格迁移、遥感图像、行为识别、视频理解、图像融合、图像检索、论文投稿&交流、PyTorch、TensorFlow和Transformer、NeRF、3DGS、Mamba等。 一定要备注:研究方向+地点+学校/公司+昵称(如Mamba、多模态学习或者扩散模型+上海+上交+卡卡),根据格式备注,可更快被通过且邀请进群

▲扫码或加微信号: CVer2233,进交流群 CVer计算机视觉(知识星球)来了!想要了解最新最快最好的CV/DL/AI论文速递、优质实战项目、AI行业前沿、从入门到精通学习教程等资料,欢迎扫描下方二维码,加入CVer计算机视觉(知识星球),已汇集上万人! ▲扫码加入星球学习▲扫码或加微信号: CVer2233,进交流群 CVer计算机视觉(知识星球)来了!想要了解最新最快最好的CV/DL/AI论文速递、优质实战项目、AI行业前沿、从入门到精通学习教程等资料,欢迎扫描下方二维码,加入CVer计算机视觉(知识星球),已汇集上万人! ▲扫码加入星球学习▲扫码或加微信号: CVer2233,进交流群 CVer计算机视觉(知识星球)来了!想要了解最新最快最好的CV/DL/AI论文速递、优质实战项目、AI行业前沿、从入门到精通学习教程等资料,欢迎扫描下方二维码,加入CVer计算机视觉(知识星球),已汇集上万人! ▲扫码加入星球学习

▲点击上方卡片,关注CVer公众号 整理不易,请赞和在看▲点击上方卡片,关注CVer公众号 整理不易,请赞和在看▲点击上方卡片,关注CVer公众号 整理不易,请赞和在看

原文链接:https://blog.csdn.net/amusi1994/article/details/144706487?ops_request_misc=%257B%2522request%255Fid%2522%253A%25228eb6c06e561e659638524c2e1a3132fd%2522%252C%2522scm%2522%253A%252220140713.130102334.pc%255Fblog.%2522%257D&request_id=8eb6c06e561e659638524c2e1a3132fd&biz_id=0&utm_medium=distribute.pc_search_result.none-task-blog-2~blog~first_rank_ecpm_v1~times_rank-28-144706487-null-null.nonecase&utm_term=%E5%B0%8F%E7%B1%B3nas